El Fantasma en la Máquina: Derechos y Responsabilidades de la IA

¡Bienvenido a HistoriaCompu, donde la evolución de la computación cobra vida! Sumérgete en el fascinante mundo de la historia de la tecnología, desde sus inicios hasta las innovaciones más impactantes. Descubre cómo la inteligencia artificial ha revolucionado nuestra sociedad y explora en nuestro artículo principal "El Fantasma en la Máquina: Derechos y Responsabilidades de la IA" las implicaciones éticas y legales que rodean a esta poderosa tecnología. ¿Estás listo para desentrañar los misterios de la IA? ¡Adelante, la aventura te espera!

- Introducción a la ética en la inteligencia artificial

- Derechos y responsabilidades de la inteligencia artificial

- Desarrollo histórico de la ética en la inteligencia artificial

- Regulaciones actuales y futuras sobre la inteligencia artificial

- Ética y responsabilidad en el desarrollo de la inteligencia artificial

- Conclusiones sobre los derechos y responsabilidades de la inteligencia artificial

- Preguntas frecuentes

- Reflexión final: Los desafíos éticos de la inteligencia artificial

Introducción a la ética en la inteligencia artificial

Definición de inteligencia artificial

La inteligencia artificial, comúnmente abreviada como IA, se refiere a la capacidad de las máquinas para realizar tareas que normalmente requieren inteligencia humana. Esto incluye el aprendizaje, el razonamiento, la percepción, la comprensión del lenguaje natural y la toma de decisiones. La IA se ha vuelto omnipresente en la sociedad moderna, desde los sistemas de recomendación en plataformas de streaming hasta los vehículos autónomos.

Los sistemas de IA pueden operar de forma autónoma o asistida, y se clasifican en categorías como IA débil y IA fuerte. La IA débil se enfoca en tareas específicas y no tiene conciencia ni autoaprendizaje, mientras que la IA fuerte busca emular la inteligencia humana en su totalidad, incluyendo la autoconciencia y la capacidad de razonamiento abstracto.

La evolución de la IA ha generado un debate en torno a las implicaciones éticas y sociales de su aplicación, lo que ha llevado a la necesidad de establecer pautas y regulaciones para su desarrollo y uso.

Importancia de la ética en la inteligencia artificial

La importancia de la ética en la inteligencia artificial radica en la necesidad de garantizar que su desarrollo y aplicación respeten los valores humanos fundamentales, eviten sesgos injustos y minimicen los riesgos potenciales. A medida que la IA se integra en áreas críticas como la atención médica, la justicia, la seguridad y el empleo, es crucial abordar las implicaciones éticas para asegurar que sus beneficios superen sus posibles perjuicios.

Las decisiones tomadas por los sistemas de IA pueden tener un impacto significativo en la vida de las personas, lo que subraya la importancia de considerar aspectos éticos como la transparencia, la equidad, la privacidad y la responsabilidad. La ética en la inteligencia artificial busca garantizar que los algoritmos y sistemas de IA sean justos, seguros, fiables y socialmente responsables.

Además, la ética en la inteligencia artificial también abarca la reflexión sobre cuestiones filosóficas y morales relacionadas con la creación de entidades con capacidades cognitivas similares a las humanas, lo que plantea interrogantes sobre la identidad, la autonomía y la interacción entre humanos y máquinas.

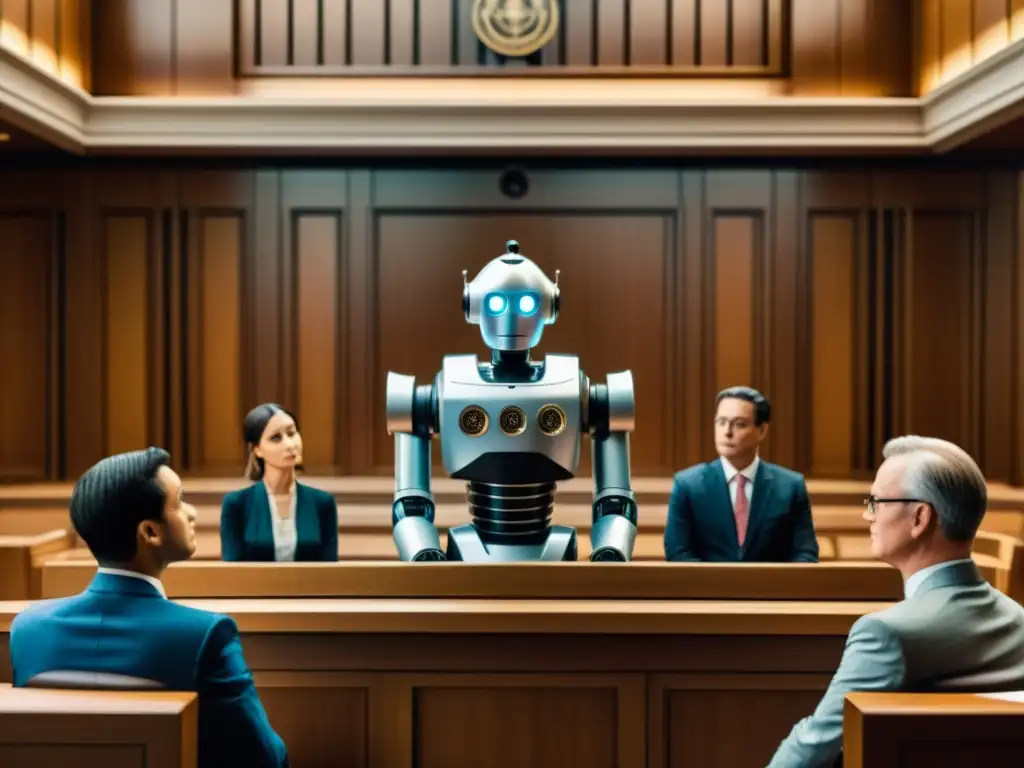

Derechos y responsabilidades de la inteligencia artificial

La inteligencia artificial (IA) ha avanzado a pasos agigantados en las últimas décadas, lo que plantea importantes interrogantes sobre los derechos legales y las responsabilidades éticas que deben regir su desarrollo y aplicación. En el ámbito legal, surge la interrogante sobre si las IA deberían tener derechos similares a los de los seres humanos. Por ejemplo, en casos de IA avanzada, ¿debería tener derecho a la propiedad de sus propias creaciones o a la protección de su "personalidad" digital?

Por otro lado, en términos de responsabilidades éticas, es vital considerar quién es responsable en caso de que una IA cause daños o cometa errores. Esto plantea desafíos significativos, ya que las IA pueden actuar de manera autónoma, lo que dificulta determinar quién debería asumir la responsabilidad en tales situaciones. Es crucial debatir y establecer un marco ético claro que defina las responsabilidades de los desarrolladores, propietarios y usuarios de la IA, así como las posibles consecuencias legales de sus acciones.

En este sentido, es fundamental abordar estas cuestiones desde una perspectiva global, involucrando a gobiernos, organizaciones internacionales, expertos legales y éticos, así como a la sociedad en general, para establecer un marco legal y ético que regule el desarrollo y uso de la inteligencia artificial de manera justa y segura para todos los actores involucrados.

Desarrollo histórico de la ética en la inteligencia artificial

Primeros debates sobre la ética en la inteligencia artificial

Los primeros debates sobre la ética en la inteligencia artificial se remontan a mediados del siglo XX, cuando pioneros como Alan Turing y Norbert Wiener comenzaron a plantear cuestiones fundamentales sobre la relación entre la máquina y la moralidad. El famoso Test de Turing, propuesto por Alan Turing en 1950, planteó la cuestión de si una máquina podría exhibir un comportamiento inteligente equivalente o indistinguible del de un ser humano. Este hito marcó el inicio de las reflexiones sobre la ética y la responsabilidad en el desarrollo de la inteligencia artificial.

Con el avance de la informática y la robótica, surgieron preocupaciones éticas relacionadas con la autonomía de las máquinas, la toma de decisiones basada en algoritmos y el impacto en la sociedad y el mercado laboral. Estos debates pioneros sentaron las bases para la reflexión contemporánea sobre los derechos y responsabilidades de la inteligencia artificial.

En la actualidad, la ética en la inteligencia artificial abarca temas como la privacidad, la equidad, la transparencia y la responsabilidad social, generando un amplio espectro de consideraciones éticas y legales que deben abordarse en el desarrollo y la implementación de sistemas de IA.

Hitos en la evolución de los derechos y responsabilidades de la IA

La evolución de los derechos y responsabilidades de la inteligencia artificial ha experimentado hitos significativos a lo largo de las últimas décadas. Uno de los puntos de inflexión más destacados fue la creación de la Ley de Protección de Datos de la Unión Europea en 2018, que estableció directrices claras para el uso ético de la inteligencia artificial y la protección de la privacidad de los ciudadanos.

Otro hito importante fue el surgimiento de los Principios de Ética en la Inteligencia Artificial de la OCDE en 2019, que definen directrices para el diseño y la implementación responsables de la IA, abordando aspectos éticos, legales y sociales. Estos principios han sentado las bases para el desarrollo de marcos regulatorios en diversos países y organizaciones, promoviendo la adopción de prácticas éticas en el campo de la inteligencia artificial.

En la evolución de los derechos y responsabilidades de la IA, se han producido avances significativos en la definición de estándares éticos y legales, así como en la promoción de la transparencia y la rendición de cuentas en el desarrollo y la aplicación de la inteligencia artificial.

Regulaciones actuales y futuras sobre la inteligencia artificial

La regulación de la inteligencia artificial (IA) es un tema de creciente importancia en el ámbito legal y tecnológico. En la actualidad, el marco legal en relación a la inteligencia artificial varía significativamente de un país a otro. Algunas naciones han implementado regulaciones específicas para abordar el uso de la IA en sectores como la salud, la seguridad y la privacidad, mientras que otras aún están en proceso de desarrollo de legislación al respecto.

En general, las regulaciones actuales suelen centrarse en cuestiones éticas y de responsabilidad, buscando establecer principios para el diseño, la implementación y el uso de sistemas de IA. Estos principios incluyen la transparencia en los algoritmos utilizados, la equidad y la no discriminación, la privacidad de los datos, y la supervisión humana en la toma de decisiones críticas.

Por otro lado, las propuestas y tendencias futuras en la regulación de la inteligencia artificial apuntan hacia un enfoque más amplio y coherente a nivel internacional. Se espera que las organizaciones y gobiernos trabajen en conjunto para establecer estándares comunes que aborden los desafíos éticos y legales planteados por el avance de la IA en diversos sectores. Entre las propuestas más destacadas se encuentran la creación de agencias reguladoras especializadas en IA, la definición de responsabilidades legales claras para los sistemas de IA, y la implementación de mecanismos de rendición de cuentas para los desarrolladores y usuarios de estas tecnologías.

Ética y responsabilidad en el desarrollo de la inteligencia artificial

Ética en la creación de algoritmos y sistemas de IA

La ética en la creación de algoritmos y sistemas de inteligencia artificial es un tema crucial en la actualidad. A medida que la IA se vuelve cada vez más omnipresente en nuestra sociedad, es fundamental considerar cómo se están utilizando los datos y qué impacto tienen las decisiones tomadas por los algoritmos en la vida de las personas.

La transparencia en el desarrollo de algoritmos es un aspecto clave de la ética en la IA. Los desarrolladores deben asegurarse de que los algoritmos sean comprensibles y explicables, evitando así la opacidad que pueda llevar a decisiones discriminatorias o perjudiciales. Además, la inclusión de múltiples perspectivas éticas y culturales en el diseño de algoritmos puede ayudar a mitigar posibles sesgos y promover la equidad en su aplicación.

Por otro lado, la responsabilidad ética también recae en la recopilación y uso de datos para entrenar los algoritmos de IA. Es fundamental garantizar la privacidad y seguridad de los datos, así como obtener el consentimiento informado de las personas cuya información se utiliza en el proceso de desarrollo de la IA.

Responsabilidad de los desarrolladores y empresas en el uso de la inteligencia artificial

Los desarrolladores y las empresas que utilizan la inteligencia artificial tienen la responsabilidad de garantizar que sus aplicaciones y sistemas sean éticos y respeten los derechos de los individuos. Esto implica no solo el diseño ético de los algoritmos, sino también la implementación de salvaguardias para prevenir el mal uso de la IA.

La rendición de cuentas es un aspecto crucial de la responsabilidad en el uso de la inteligencia artificial. Los desarrolladores y las empresas deben ser transparentes sobre cómo se utiliza la IA y qué impacto tiene en las personas y la sociedad en general. Además, deben establecer mecanismos para corregir y compensar posibles errores o daños causados por sus sistemas de IA.

La ética y la responsabilidad en el desarrollo y uso de la inteligencia artificial son fundamentales para garantizar que la IA beneficie a la sociedad en su conjunto, sin comprometer los derechos y la dignidad de las personas.

Conclusiones sobre los derechos y responsabilidades de la inteligencia artificial

Balance entre avances tecnológicos y consideraciones éticas

El avance de la inteligencia artificial ha revolucionado numerosos aspectos de la sociedad, desde la atención médica y la logística hasta la toma de decisiones financieras y la interacción social. Sin embargo, este progreso vertiginoso plantea importantes interrogantes éticos. La necesidad de equilibrar el impulso por innovar con la responsabilidad de garantizar el bienestar humano y el respeto a los derechos fundamentales es crucial.

Las consideraciones éticas en torno a la IA abarcan desde la privacidad y la seguridad hasta la transparencia en la toma de decisiones algorítmicas. Es fundamental establecer mecanismos de supervisión y regulación que aseguren que los avances tecnológicos no comprometan los derechos humanos ni generen discriminación o sesgos injustos.

Por tanto, el desafío radica en promover el desarrollo de la inteligencia artificial de manera responsable, fomentando la innovación al tiempo que se protegen los valores éticos y los derechos fundamentales de las personas.

Desafíos futuros en la garantía de derechos y responsabilidades de la inteligencia artificial

El camino hacia la plena garantía de los derechos y responsabilidades de la inteligencia artificial presenta desafíos significativos. Entre ellos se encuentra la necesidad de establecer marcos legales y normativos que regulen el uso y la implementación de la IA en diversos ámbitos, desde el empleo hasta la justicia y la seguridad.

Además, la transparencia y la explicabilidad de los algoritmos son aspectos cruciales para asegurar que las decisiones automatizadas sean comprensibles y no discriminatorias. La rendición de cuentas y la trazabilidad de las decisiones de la IA son elementos esenciales para garantizar la responsabilidad y prevenir posibles impactos negativos.

Asimismo, el fomento de la alfabetización digital y ética, tanto en la ciudadanía como en los profesionales del sector, desempeña un papel fundamental en la promoción de un uso ético y responsable de la inteligencia artificial.

Preguntas frecuentes

1. ¿Cuáles son los derechos de la IA?

Los derechos de la IA incluyen el acceso a datos, la protección contra el sesgo algorítmico y la transparencia en la toma de decisiones.

2. ¿Cuáles son las responsabilidades de la IA?

Las responsabilidades de la IA abarcan la toma de decisiones éticas, la minimización de riesgos y la rendición de cuentas por sus acciones.

3. ¿Cómo se protegen los derechos de los individuos frente a la IA?

Los derechos de los individuos frente a la IA se protegen mediante la regulación, la auditoría de algoritmos y la participación pública en el desarrollo de tecnologías.

4. ¿Qué papel juegan los gobiernos en la regulación de la IA?

Los gobiernos tienen el papel de establecer marcos legales, promover estándares éticos y supervisar el uso responsable de la IA en la sociedad.

5. ¿Cómo pueden las empresas promover el uso ético de la IA?

Las empresas pueden promover el uso ético de la IA mediante la implementación de políticas de gobierno de datos, la capacitación en ética y la colaboración con expertos en derechos digitales.

Reflexión final: Los desafíos éticos de la inteligencia artificial

La discusión sobre los derechos y responsabilidades de la inteligencia artificial es más relevante que nunca en nuestra sociedad actual, donde la tecnología avanza a pasos agigantados y su impacto en nuestras vidas es cada vez más profundo.

La influencia de la inteligencia artificial en nuestra cultura y forma de vida es innegable, y como sociedad debemos reflexionar sobre cómo queremos que esta tecnología nos represente. Como dijo Stephen Hawking, "El desarrollo de la inteligencia artificial completa podría significar el fin de la raza humana". Stephen Hawking

.

Es crucial que cada individuo tome conciencia de la importancia de abordar estos temas éticos y se involucre en la conversación. Solo a través de la reflexión y la acción consciente podremos garantizar que la inteligencia artificial se desarrolle de manera responsable y respetuosa hacia los derechos humanos y la sociedad en su conjunto.

¡Gracias por formar parte de la comunidad de HistoriaCompu!

¿Te encantó descubrir más sobre los derechos y responsabilidades de la inteligencia artificial? Comparte este fascinante artículo en redes sociales y despierta la curiosidad de tus amigos. ¿Tienes alguna idea para futuros artículos relacionados con la tecnología? ¡Nos encantaría conocer tus sugerencias! Explora más contenido en HistoriaCompu y no olvides dejar tus comentarios. ¿Qué opinas sobre el impacto de la IA en nuestra sociedad?

El nacimiento de un gigante: La historia de cómo Nintendo cambió el juego

El nacimiento de un gigante: La historia de cómo Nintendo cambió el juego Música para jugar: La influencia de los videojuegos en la música contemporánea

Música para jugar: La influencia de los videojuegos en la música contemporánea La IA en la Asistencia Sanitaria: ¿Puede Respetar la Confidencialidad del Paciente?

La IA en la Asistencia Sanitaria: ¿Puede Respetar la Confidencialidad del Paciente?Si quieres conocer otros artículos parecidos a El Fantasma en la Máquina: Derechos y Responsabilidades de la IA puedes visitar la categoría Ética en la Inteligencia Artificial.

Deja una respuesta

Articulos relacionados: